Cara Menjalankan Stable Diffusion: Panduan Langkah demi Langkah

Bekerja sama dengan beberapa peneliti akademis dan organisasi nirlaba, Stability AI, perusahaan rintisan yang didirikan pada tahun 2019, mengembangkan model Stable Diffusion, yang pertama kali dirilis pada tahun 2022, berikut cara menjalankan stable diffusion menurut teknolologigateway.com.

Stable Diffusion adalah model pembelajaran mendalam sumber terbuka yang dirancang untuk menghasilkan gambar berkualitas tinggi dan terperinci dari deskripsi teks. Model ini juga dapat memodifikasi gambar yang ada atau menyempurnakan gambar beresolusi rendah menggunakan masukan teks. Model ini terus berkembang, dengan kemajuan terbaru yang meningkatkan kinerja dan kemampuannya.

Dalam artikel ini, kita akan mengupas cara kerja Stable Diffusion dan membahas berbagai metode untuk menjalankannya.

Pelajari cara menggunakan Stable Diffusion, model pembelajaran mendalam sumber terbuka canggih yang menghasilkan gambar berkualitas tinggi dari deskripsi teks. Tutorial ini membahas dasar-dasar cara kerja model dan petunjuk langkah demi langkah untuk menjalankan Stable Diffusion secara daring dan lokal.

Apa itu Stable Diffusion?

Stable Diffusion adalah model pembelajaran mendalam sumber terbuka yang canggih yang dikembangkan oleh Stability AI. Dirilis pada tahun 2022, model ini unggul dalam menghasilkan gambar berkualitas tinggi dan terperinci dari deskripsi tekstual. Model serbaguna ini dapat memodifikasi gambar yang ada atau menyempurnakan gambar beresolusi rendah menggunakan input teks.

Awalnya dilatih pada kumpulan data besar berisi 2,3 miliar gambar, Stable Diffusion memanfaatkan prinsip pemodelan generatif dan proses Diffusion. Hal ini memungkinkannya untuk membuat gambar baru yang realistis dengan mempelajari pola dan struktur dari data pelatihan. Kemampuannya sebanding dengan model canggih lainnya, menjadikannya alat yang hebat untuk berbagai aplikasi dalam pembuatan dan manipulasi gambar.

Pada bulan Februari 2024, Stability AI mengumumkan Stable Diffusion 3 dalam pratinjau awal, yang menampilkan peningkatan kinerja yang sangat besar, terutama dalam menangani perintah multi-subjek, kualitas gambar, dan ejaan. Rangkaian Stable Diffusion 3 berkisar antara 800 juta hingga 8 miliar parameter, yang menekankan skalabilitas dan kualitas untuk memenuhi berbagai kebutuhan kreatif. Pada bulan Juni 2024, peluncuran Stable Diffusion 3 Medium , model dengan 2 miliar parameter, menandai kemajuan yang signifikan, yang menawarkan detail, warna, dan fotorealisme yang luar biasa sekaligus berjalan secara efisien pada GPU konsumen standar.

Stable Diffusion 3 menggabungkan arsitektur Multimodal Diffusion Transformer (MMDiT) baru, yang menggunakan set bobot terpisah untuk representasi gambar dan bahasa. Inovasi ini meningkatkan pemahaman teks dan kemampuan mengeja dibandingkan dengan versi model sebelumnya. Berdasarkan evaluasi preferensi manusia, Stable Diffusion 3 mengungguli sistem pembangkitan teks ke gambar terkemuka lainnya seperti DALL·E 3, Midjourney v6, dan Ideogram v1 dalam tipografi dan kepatuhan cepat.

Stability AI telah menerbitkan makalah penelitian komprehensif yang merinci teknologi dasar Stable Diffusion 3, yang menyoroti kemajuan dan kinerjanya yang unggul. Peningkatan ini menjadikan Stable Diffusion 3 alat yang hebat untuk menghasilkan gambar berkualitas tinggi dari deskripsi tekstual, dengan peningkatan penting dalam menangani perintah yang rumit dan menghasilkan keluaran yang realistis.

Bagaimana Stable Diffusion Bekerja?

Stable Diffusion adalah contoh canggih dari kelas model pembelajaran mendalam yang dikenal sebagai model Diffusion. Lebih khusus lagi, model ini termasuk dalam kategori model generatif. Model-model ini dirancang untuk menghasilkan data baru yang mirip dengan data yang digunakan untuk melatihnya, sehingga memungkinkan mereka untuk membuat keluaran baru yang realistis berdasarkan pola dan struktur yang dipelajari.

Model Diffusion terinspirasi oleh konsep Diffusion dalam fisika, di mana partikel menyebar dari area dengan konsentrasi tinggi ke konsentrasi rendah seiring waktu. Dalam konteks pembelajaran mendalam, model Diffusion mensimulasikan proses ini dalam ruang data berdimensi tinggi. Model dimulai dengan gangguan acak dan secara berulang menyempurnakan gangguan ini melalui serangkaian langkah untuk menghasilkan gambar yang koheren dan berkualitas tinggi.

Pemodelan generatif, jenis pembelajaran tanpa pengawasan , melibatkan pelatihan model untuk menemukan dan mempelajari pola dalam data masukan secara otomatis. Setelah dilatih, model ini dapat menghasilkan contoh baru yang menyerupai data asli. Kemampuan ini membuat model generatif sangat berguna untuk tugas-tugas seperti sintesis gambar, penambahan data, dan banyak lagi.

Jika Anda ingin mengetahui lebih lanjut tentang model ini, pertimbangkan untuk mengikuti jalur kursus Pembelajaran Mendalam dalam Python kami.

Proses Diffusion

Proses Diffusion dalam Stable Diffusion melibatkan dua fase utama: proses Diffusion maju dan proses penghilangan derau mundur.

- Proses Diffusion maju:

Tahap ini melibatkan penambahan noise secara bertahap ke data pelatihan (gambar) selama beberapa langkah hingga gambar menjadi noise murni. Proses ini dirancang secara matematis agar dapat dibalik.

- Proses penghilangan noise terbalik:

Selama fase ini, model belajar untuk membalikkan proses penambahan noise. Dimulai dari noise acak, model secara berulang menghilangkan noise pada gambar melalui beberapa langkah, secara bertahap merekonstruksi gambar yang koheren dan berkualitas tinggi. Proses pembalikan ini dipandu oleh pola dan struktur yang dipelajari dari data pelatihan.

Arsitektur Transformator Diffusion Multimodal (MMDiT)

Stable Diffusion 3 memperkenalkan arsitektur baru yang dikenal sebagai Multimodal Diffusion Transformer (MMDiT). Arsitektur ini menggunakan set bobot terpisah untuk representasi gambar dan bahasa, yang meningkatkan kemampuan model untuk memahami dan menghasilkan perintah berbasis teks. Dengan menggunakan jalur yang berbeda untuk memproses gambar dan informasi tekstual, MMDiT meningkatkan koherensi dan akurasi gambar yang dihasilkan, terutama dalam menangani perintah dan tipografi yang kompleks.

Aplikasi Praktis Stable Diffusion

Stable Diffusion dapat digunakan untuk berbagai aplikasi praktis, termasuk:

- Pembuatan gambar : Membuat gambar baru dari deskripsi tekstual.

- Modifikasi gambar : Mengubah gambar yang ada berdasarkan perintah teks.

- Peningkatan gambar : Meningkatkan kualitas gambar beresolusi rendah.

Kemampuan ini menjadikan Stable Diffusion alat yang ampuh bagi seniman, desainer, peneliti, dan siapa saja yang tertarik mengeksplorasi potensi AI generatif .

Cara Menjalankan Stable Diffusion Secara Online

Jika Anda ingin segera mulai menggunakan model Stable Diffusion, Anda dapat menjalankannya secara daring menggunakan alat berikut.

- DreamStudio

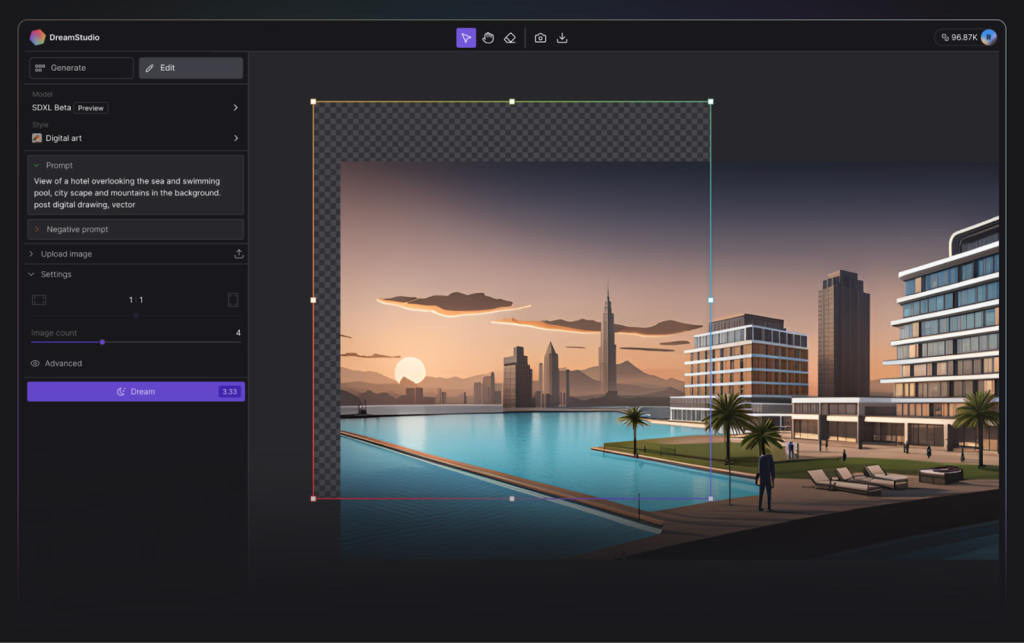

Stability AI, pencipta Stable Diffusion, telah membuatnya sangat mudah bagi pihak-pihak yang penasaran untuk menguji model teks-ke-gambar mereka dengan alat daring mereka, DreamStudio.

DreamStudio memberi pengguna akses ke model Stable Diffusion versi terbaru dan memungkinkan mereka menghasilkan gambar hingga dalam 15 detik.

Antarmuka pengguna DreamStudio. Sumber gambar: DreamStudio

Saat menulis tutorial ini, pengguna baru menerima 100 kredit gratis untuk mencoba DreamStudio, yang cukup untuk 500 gambar menggunakan pengaturan default! Kredit tambahan dapat dibeli dalam aplikasi sesuai keinginan Anda, dengan biaya hanya $10,00 per 1000 kredit.

- Wajah Pelukan

Hugging Face adalah komunitas dan platform AI yang mempromosikan kontribusi sumber terbuka. Meskipun sangat dikenal karena model transformernya , Hugging Face juga menyediakan akses ke model Stable Diffusion terbaru , dan seperti pencinta sejati sumber terbuka, model ini gratis.

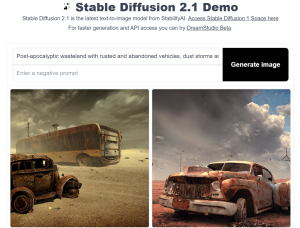

Untuk menjalankan Stable Diffusion di Hugging Face, Anda dapat mencoba salah satu demo, seperti demo Stable Diffusion 2.1 .

Kekurangannya dengan Hugging Face adalah Anda tidak dapat menyesuaikan properti seperti yang dapat Anda lakukan di DreamStudio, dan butuh waktu lebih lama untuk menghasilkan gambar.

Demo Stable Diffusion di Hugging Face. Gambar oleh penulis.

Cara Menjalankan Stable Diffusion Secara Lokal

Namun, bagaimana jika Anda ingin mencoba Stable Diffusion di komputer lokal Anda? Kami siap membantu Anda.

Menjalankan Stable Diffusion secara lokal memungkinkan Anda bereksperimen dengan berbagai masukan teks untuk menghasilkan gambar yang lebih sesuai dengan kebutuhan Anda. Anda juga dapat menyempurnakan model pada data Anda untuk meningkatkan hasil, dengan mempertimbangkan masukan yang Anda berikan.

Penafian: Anda harus memiliki GPU untuk menjalankan Stable Diffusion secara lokal.

Langkah 1: Instal Python dan Git

Untuk menjalankan Stable Diffusion dari komputer lokal, Anda memerlukan Python 3.10.6. Ini dapat diinstal dari Situs Web Python resmi . Jika Anda mengalami kendala, lihat tutorial Cara Menginstal Python kami.

Periksa apakah penginstalan berfungsi dengan benar dengan membuka command prompt, mengetik python, dan menjalankan perintah. Ini akan menampilkan versi Python yang Anda gunakan.

Penafian: Versi yang direkomendasikan untuk menjalankan Stable Diffusion adalah Python 3.10.6. Kami sarankan untuk tidak melanjutkan tanpa versi ini guna menghindari masalah.

Berikutnya, Anda harus memasang sistem manajemen repositori kode Git. Tutorial Instalasi Git dapat membantu, dan kursus Pengantar Git kami dapat memperdalam pengetahuan Anda tentang Git.

Langkah 2: Buat akun GitHub dan Hugging Face

GitHub adalah layanan hosting pengembangan perangkat lunak tempat para pengembang menghosting kode mereka sehingga mereka dapat melacak dan berkolaborasi dengan para pengembang lain dalam berbagai proyek. Jika Anda belum memiliki akun Github, sekarang juga saat yang tepat untuk membuatnya—lihat Github dan Tutorial Git untuk Pemula untuk mendapatkan bantuan.

Hugging Face , di sisi lain, adalah komunitas AI yang mendukung kontribusi sumber terbuka. Komunitas ini merupakan pusat beberapa model AI dari berbagai domain, termasuk pemrosesan bahasa alami , visi komputer , dan banyak lagi. Anda memerlukan akun untuk mengunduh Stable Diffusion versi terbaru. Kita akan membahas langkah ini nanti.

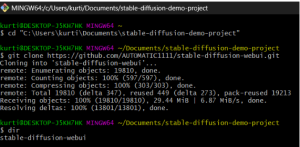

Langkah 3: Kloning Web-UI Stable Diffusion

Pada langkah ini, Anda akan mengunduh Stable Diffusion Web-UI ke komputer lokal Anda. Meskipun berguna untuk membuat folder khusus (misalnya, stable-diffusion-demo-project) untuk tujuan ini, hal itu tidak wajib.

- Buka Git Bash:

- Pastikan Anda telah memasang Git Bash di komputer Anda.

- Arahkan ke folder yang Anda inginkan:

- Buka Git Bash dan gunakan cdperintah untuk menavigasi ke folder tempat Anda ingin mengkloning Stable Diffusion Web-UI. Misalnya:

“cd path/to/your/folder”

- Kloning repositori:

- Jalankan perintah berikut untuk mengkloning repositori Web-UI Stable Diffusion:

“git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git”

- Verifikasi klon:

- Jika perintah berhasil dijalankan, Anda akan melihat folder baru bernama stable-diffusion-webuidi direktori pilihan Anda.

Catatan: Anda dapat menemukan petunjuk yang lebih spesifik untuk perangkat keras dan sistem operasi Anda di repositori Github UI web Stable Diffusion .

Langkah 4: Unduh model Stable Diffusion terbaru

- Masuk ke Hugging Face:

- Akses akun Hugging Face Anda.

- Unduh model Stable Diffusion:

- Temukan dan unduh model Stable Diffusion yang ingin Anda jalankan dari Hugging Face. File-file ini berukuran besar, jadi pengunduhan mungkin memerlukan waktu beberapa menit.

- Temukan folder model:

- Arahkan ke folder berikut di komputer Anda:stable-diffusion-webui\models\Stable-diffusion

- Pindahkan model yang diunduh:

- Dalam Stable-diffusionfolder tersebut, Anda akan melihat berkas teks bernama Put Stable Diffusion Checkpoints here.

- Pindahkan file model Stable Diffusion yang diunduh ke folder ini.

Langkah 5: Siapkan UI web Stable Diffusion

Pada langkah ini, Anda akan menginstal alat yang diperlukan untuk menjalankan Stable Diffusion.

- Buka Command Prompt atau Terminal.

- Navigasi ke folder UI web Stable Diffusion:

- Gunakan cdperintah tersebut untuk menavigasi ke stable-diffusion-webuifolder yang Anda kloning sebelumnya. Misalnya:

“cd path/to/stable-diffusion-webui”

- Jalankan skrip pengaturan:

- Setelah Anda berada di stable-diffusion-webuifolder tersebut, jalankan perintah berikut:

“webui-user.bat”

Skrip ini akan membuat lingkungan virtual dan memasang semua dependensi yang diperlukan untuk menjalankan Stable Diffusion. Proses ini mungkin memakan waktu sekitar 10 menit, jadi harap bersabar.

Catatan: Anda dapat menemukan petunjuk yang lebih spesifik untuk perangkat keras dan sistem operasi Anda di repositori Github UI web Stable Diffusion .

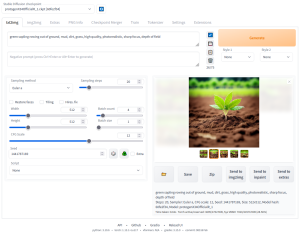

Langkah 6: Jalankan Stable Diffusion secara lokal

Setelah dependensi diinstal, URL akan muncul di prompt perintah Anda: http://127.0.0.1:7860 .

- Salin dan tempel ini ke peramban web Anda untuk menjalankan UI web Stable Diffusion.

- Sekarang, Anda dapat mulai menjalankan perintah dan menghasilkan gambar!

Antarmuka pengguna web Diffusion yang stabil dan berjalan secara lokal. Gambar oleh penulis.

Kesimpulan

Stable Diffusion merupakan kemajuan signifikan dalam bidang AI generatif. Ia menawarkan kemampuan untuk menghasilkan gambar berkualitas tinggi dan terperinci dari deskripsi tekstual. Apakah Anda ingin memodifikasi gambar yang sudah ada, menyempurnakan gambar beresolusi rendah, atau membuat visual yang sama sekali baru, Stable Diffusion menyediakan perangkat yang canggih dan serbaguna.

Dengan pembaruan dan penyempurnaan terkini dalam Stable Diffusion 3 dan Medium, kemampuan model tersebut telah ditingkatkan lebih jauh dan menjadikannya pemimpin dalam ruang AI generatif.

Menjalankan Stable Diffusion secara lokal atau melalui berbagai platform daring seperti DreamStudio dan Hugging Face memungkinkan Anda untuk mengeksplorasi dan memanfaatkan potensinya secara penuh. Dengan mengikuti langkah-langkah yang diuraikan dalam panduan ini, Anda dapat menyiapkan dan mulai menggunakan Stable Diffusion untuk memenuhi kebutuhan kreatif dan praktis Anda!